تقنية جديدة من مايكروسوفت لمحاربة Deepfakes

يمكن أن تكون تقنية Deepfakes أحيانًا مصدرًا للترفيه، عند استخدامها في سياق الأفلام والميمات، لكنها أيضًا مصدر قلق متزايد، ففي عصر الأخبار المزيفة والمعلومات المضللة يمكن استخدام تقنية Deepfakes – أي الصور أو مقاطع الفيديو أو الملفات الصوتية التي تم إنشاؤها بواسطة الذكاء الاصطناعي أو التلاعب بها – لإرباك الناس وتضليلهم، لكن شركة مايكروسوفت لديها أفكار أخرى.

حيث أعلنت الشركة يوم الثلاثاء عن تقنيتين جديدتين، تهدفان إلى تزويد القراء بالأدوات اللازمة لتصفية ما هو حقيقي وما هو غير حقيقي.

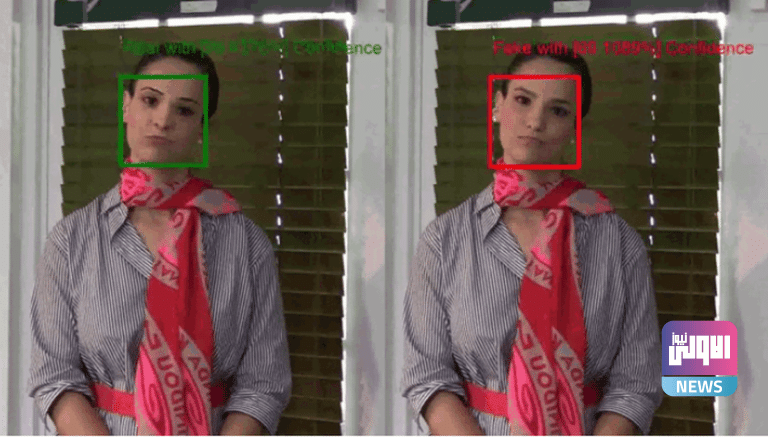

التقنية الأولى التي تحمل اسم (Microsoft Video Authenticator)، تحلل الصور ومقاطع الفيديو لإعطاء فرصة نسبية أو درجة من الثقة بأن الوسائط تم التلاعب بها بشكل مصطنع، وحسب مدونة موقع مايكروسوفت الرسمي، تعمل الأداة على كشف تقنية Deepfakes من خلال الكشف عن العناصر الممزوجة للصورة التي ربما لم تلتقطها أعيننا البشرية الواهية مثل التلاشي الدقيق وعناصر التدرج الرمادي والحدود.

أما التقنية الثانية ستكون متاحة كجزء من خدمة السحابة (Azure) الخاصة بشركة مايكروسوفت للمبدعين، وذلك بإضافة (تجزئات وشهادات رقمية) إلى الصور أو مقاطع الفيديو للكشف عن تقنية Deepfakes، ثم تعيش هذه في البيانات الوصفية عندما تنشر وسائل الإعلام عبر الإنترنت، حيث ستقوم هذه التقنية، التي تعتبر إضافة للمتصفح، بعد ذلك بمطابقة هذه التجزئة مما يمنح القراء معلومات حول من أنشأ المحتوى في الأصل، وما إذا كان قد تم تغييره منذ ذلك الحين أم لا.

هل حُلت مشكلة استخدام تقنية Deepfakes؟

ليس بالضبط، حيث تقر شركة مايكروسوفت في مدونتها بأن تقنية Deepfakes تزداد تعقيدًا باستمرار، مما يعني أن أداة الذكاء الاصطناعي الخاصة بها ستحتاج أيضًا إلى التحديث.

تجدر الإشارة إلى أن مايكروسوفت ليست الشركة الوحيدة التي تسعى جاهدة لإيجاد حل لمشكلة Deepfakes، فبعد حظرها مرة أخرى في يناير، كشف موقع فيسبوك في الفترة الأخيرة عن جهوده الخاصة لاكتشاف هذه التقنية، في حين بدأت منصة تويتر في تصنيف الوسائط المُتلاعب بها والمُصنَّعة، وطرحت منصة (Reddit) حظرها الخاص.

الاولى نيوز – متابعة